DeepGEMM

DeepGEMM est une bibliothèque conçue pour des multiplications de matrices générales FP8 (GEMMs) propres et efficaces avec un redimensionnement fin, écrite en CUDA.

Listé dans les catégories:

GitHubIntelligence artificielleOpen Source

Description

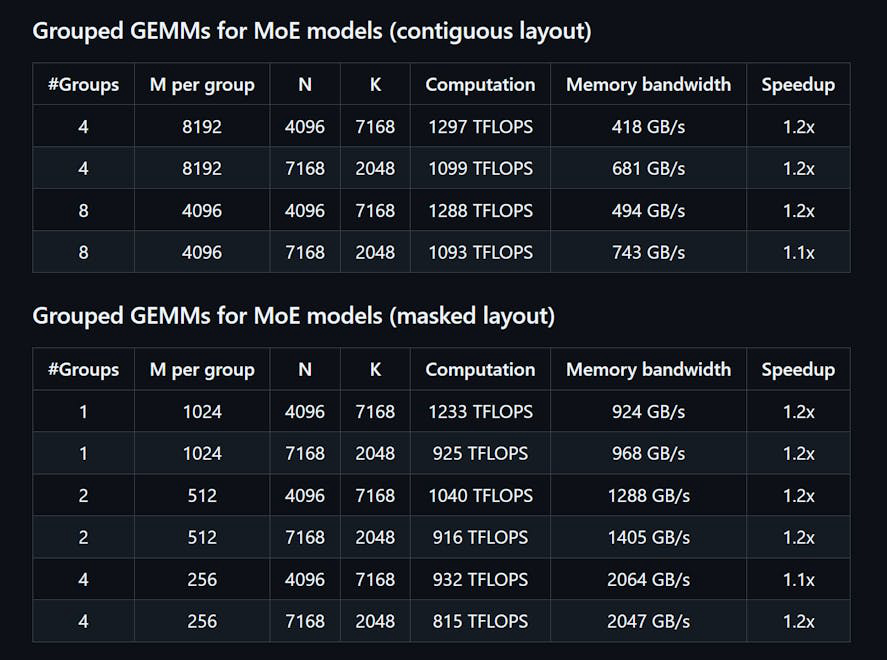

DeepGEMM est une bibliothèque conçue pour des multiplications de matrices générales (GEMM) FP8 propres et efficaces avec un redimensionnement fin, comme proposé dans DeepSeekV3. Elle prend en charge les GEMM groupés normaux et Mix-of-Experts (MoE). Écrite en CUDA, la bibliothèque compile tous les noyaux à l'exécution à l'aide d'un module Just-In-Time (JIT) léger, ne nécessitant aucune compilation lors de l'installation. DeepGEMM prend exclusivement en charge les cœurs tensoriels NVIDIA Hopper et utilise la promotion d'accumulation à deux niveaux des cœurs CUDA pour traiter l'accumulation imprécise des cœurs tensoriels FP8. Malgré son design léger, les performances de DeepGEMM égalent ou dépassent celles des bibliothèques optimisées par des experts à travers diverses formes de matrices.

Comment utiliser DeepGEMM?

Pour utiliser DeepGEMM, installez la bibliothèque via Python avec 'python setup.py install'. Importez 'deepgemm' dans votre projet Python et appelez les fonctions GEMM appropriées pour vos opérations matricielles. Assurez-vous que votre environnement répond aux exigences des versions CUDA et PyTorch.

Fonctionnalités principales de DeepGEMM:

1️⃣

Prend en charge les GEMM groupés normaux et Mix-of-Experts (MoE)

2️⃣

Écrite en CUDA avec compilation des noyaux à l'exécution

3️⃣

Optimisée pour les cœurs tensoriels NVIDIA Hopper

4️⃣

Utilise la promotion d'accumulation à deux niveaux pour FP8

5️⃣

Design léger avec une seule fonction de noyau central

Pourquoi pourrait-il être utilisé DeepGEMM?

| # | Cas d'utilisation | Statut | |

|---|---|---|---|

| # 1 | Multiplication de matrices efficace pour les modèles d'apprentissage profond | ✅ | |

| # 2 | Optimisation des performances dans les tâches d'inférence | ✅ | |

| # 3 | Utilisation de la précision FP8 pour des calculs économes en mémoire | ✅ | |

Développé par DeepGEMM?

DeepGEMM est développé par une équipe comprenant Chenggang Zhao, Liang Zhao, Jiashi Li et Zhean Xu, qui se concentre sur la fourniture de solutions efficaces pour la multiplication de matrices dans les applications d'apprentissage profond.